Den 1 augusti 2024 trädde EU:s AI-förordning i kraft – ett banbrytande regelverk som ska främja en ansvarsfull utveckling och användning av AI inom unionen. Regelverket är omfattande och stundom svårnavigerat – nedan ges en överblick över det nya regelverkets tillämpningsområde och innebörd.

EU-förordningen om artificiell intelligens (”AI-förordningen”) är världens första heltäckande regelverk för utveckling, lansering och användning av AI.

Regelverket sträcker sig över hela AI-systemets livscykel – från utveckling till användning. Det ställer krav på alla involverade parter inbegripet leverantörer, tillverkare samt användare och tillämpas på både offentliga och privata verksamheter (artikel 2).

Vissa AI-system är emellertid undantagna förordningen – t ex system för privat icke-yrkesmässig verksamhet och system för militär verksamhet.

Även om förordningen nu trätt i kraft återstår viss tid innan samtliga av dess bestämmelser börjar tillämpas. Först den 2 augusti 2026 blir så gott som hela AI-förordningen tillämplig (artikel 113).

AI-förordningen – en riskbaserad struktur

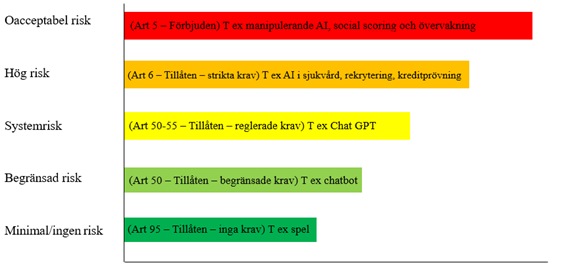

AI-förordningen klassificerar AI-system i fem risknivåer: oacceptabel risk, hög risk, systemrisk, begränsad risk och minimal risk. Klassificeringen baseras på AI-systemets avsedda ändamål och dess potentiella påverkan på människors säkerhet och rättigheter. Ju högre risk, desto striktare krav.

Organisationer uppmanas att inventera sina AI-lösningar för att identifiera, bedöma och, vid behov, vidta åtgärder baserat på de olika risknivåerna. De olika risknivåerna kan överlappa för ett och samma system, beroende på dess användningsområde.

I syfte att ge en översikt av förordningens riskbaserade struktur redogörs nedan, kort sammanfattat, för de olika riskkategorierna och deras innebörd.

- AI-system som innefattar en oacceptabel risk – t ex AI-system som används för fjärridentifiering på allmän plats eller social poängsättning – är förbjudna eftersom de anses strida mot grundläggande rättigheter och EU:s värderingar (artikel 5).

- Såsom ett system med hög risk anses, förenklat uttryckt, sådan AI som används inom kritiska områden – t ex inom skola, sjukvård eller infrastruktur – där en felaktig användning kan påverka människors liv, rättigheter eller säkerhet negativt (artikel 6 samt bilaga I och III).

- Systemrisk inom ramen för AI-förordningen avser AI-modeller för allmänna ändamål och AI-system för allmänna ändamål och de potentiella risker som AI-systemet kan medföra på en övergripande samhällsnivå. Det handlar om de risker som inte bara drabbar enskilda individer, utan som kan påverka samhällsstrukturer, ekonomi, säkerhet och demokrati (artikel 50-55).

- AI-system med en begränsad risk tar sikte på användning med vissa risker, men som inte anses vara tillräckligt allvarliga för att omfattas av samma strikta krav som AI-system med högrisk. AI-system med begränsad risk kan påverka användarens uppfattningar eller beteenden, men utan att direkt hota säkerhet, rättigheter eller kritiska samhällsfunktioner (artikel 50).

- Om ett AI-system varken är förbjudet, klassas som hög risk, omfattas av krav på transparens eller medför systemrisk, betraktas systemet utgöra minimal eller ingen risk. Sådana system, t ex AI-aktiverade videospel eller spamfilter, är således tillåtna utan några särskilda villkor enligt förordningen.

Särskilda krav beroende på riskkategori och aktör

AI-förordningen ställer särskilda krav på riskhantering, dokumentation, mänsklig kontroll, cybersäkerhet och transparens beroende på vilken roll en aktör har inom AI-systemets livscykel (artikel 2 och 3).

Leverantörer ansvarar exempelvis för att systemens utvecklingsprocess möter alla krav för tillförlitlighet och riskhantering, medan användare av AI-systemen måste säkerställa att systemen används i enlighet med riktlinjerna.

Förordningen betonar även vikten av ett heltäckande riskhanteringssystem för AI-system med hög risk. Syftet är att identifiera, bedöma och minimera risker associerade med systemet. Även ett kvalitetsstyrningssystem behöver inrättas. Genom tester, kontinuerlig övervakning och anpassade säkerhetsåtgärder ska organisationer kunna säkerställa att dessa system fungerar tillförlitligt under olika förhållanden (artikel 9, 17 och bilaga VII).

Höga sanktionsavgifter ska säkra efterlevnaden

Överträdelser av AI-förordningen kan medföra höga sanktionsavgifter. Storleken bestäms med hänsyn till bl a vilken bestämmelse i förordningen som har åsidosatts. I det enskilda fallet ska sanktionsavgiften utgöras av det högre beloppet av (i) en procentandel, upp till 7 %, av det berörda företagets årsomsättning, eller (ii) ett fast belopp mellan 7,5 miljoner EUR och 35 miljoner EUR (artikel 99).

Proaktiv anpassning i en snabbt utvecklande AI-marknad

EU:s AI-förordning avser alltså att medföra en robust regelram med höga krav, inte bara vad gäller utveckling och distribuering av AI-system, utan också på användningen av dessa.

För företag och organisationer innebär detta att de behöver ha kunskap om sina AI-lösningar, noggrant analysera riskerna och vidta proaktiva samt kontinuerliga säkerhetsåtgärder för att uppfylla förordningens krav.

Genom att i ett tidigt skede se över riskbedömningar, datasäkerhet och transparens kan organisationer inte bara säkerställa regelefterlevnad utan också stärka förtroendet hos kunder och samarbetspartners.

AI-förordningen finns tillgänglig här.

Vill du veta mer eller har frågor om den nya AI-förordningen och dess efterlevnad är du välkommen att kontakta Fredrik Ståhl, advokat och partner, eller Firel Danho, biträdande jurist, på TIME DANOWSKY Advokatbyrå.